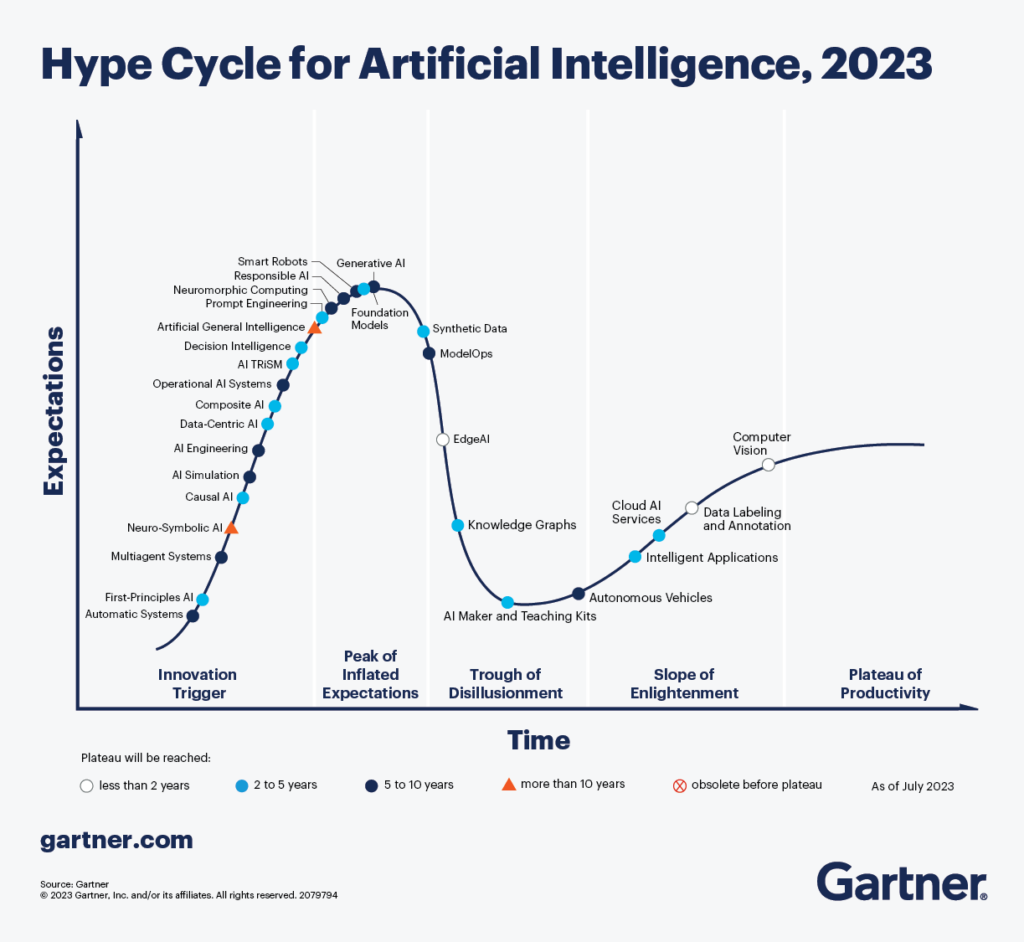

Es sabido que cada vez que surge alguna tecnología disruptiva (y todavía nos quedan muchas por ver) da comienzo un proceso de maduración, que parte de un deslumbramiento inicial centrado en la usabilidad de la tecnología y su potencial, para pasar a un debate sobre cuestiones relacionadas con los riesgos y amenazas que trae consigo la aplicación generalizada de la misma, habitualmente centradas en la defensa de la propiedad intelectual y la privacidad, por citar algunas.

En el caso de la inteligencia artificial no ha sido distinto, aunque la velocidad de penetración -quizás- haya sido mayor que en otros casos, como ocurrió con la nube o el blockchain.

Sin embargo, esa actitud, que raya lo que algunos autores han calificado, acertadamente a mi modo de ver, de ciberfatalismo, no debe desviarnos de nuestro deber de visualizar cuál puede ser el impacto que la implementación de tal tecnología vaya a tener en otros aspectos jurídicos, sociales y económicos.

Cada vez que surge alguna tecnología disruptiva, da comienzo un proceso de maduración que parte de un deslumbramiento inicial centrado en la usabilidad de la tecnología y su potencial

Si nos centramos en el ámbito empresarial, no podemos olvidar que la adopción de la Inteligencia artificial forma parte de la estrategia de innovación y mejora continua de cualquier compañía que quiera implementarla en cualquier de sus procesos.